Centro De Operações De Emergência Na COVID-19: a Experiência Do Município Do Rio De Janeiro

Revista Panamericana de Salud Pública(2022)

Secretaria Municipal de Saúde do Município do Rio de Janeiro | Fundação Oswaldo Cruz (Fiocruz)

Abstract

O presente artigo descreve a experiência de implantação de um centro de operações de emergência (COE) para coordenação da resposta à pandemia de COVID-19 no município do Rio de Janeiro, Brasil. Seguindo o modelo de gestão de emergências em saúde pública preconizado pela Organização Mundial da Saúde (OMS), este centro de caráter temporário (COE COVID-19 RIO) foi ativado em janeiro de 2021. O relato foi estruturado com base em cinco eixos temáticos: arcabouço legal; estrutura, planos e procedimentos; articulações institucionais; informações em saúde para apoio decisório; e comunicação de risco. Entre os avanços importantes relacionados ao estabelecimento desta iniciativa, destacaram-se ganhos em governança para a organização do enfrentamento à COVID-19, aumento da sinergia entre setores e instituições, maior compartilhamento de informações em relação às medidas de prevenção e controle da doença, inovação nas análises epidemiológicas e ganhos na transparência e oportunidade na tomada de decisões. Concluiu-se que, mesmo sendo concebido em estágio avançado da pandemia na cidade, o COE COVID-19 RIO teve papel relevante na estruturação da resposta. Ainda, apesar do caráter temporário do COE, a experiência mostrou-se como importante legado para a condução de futuras emergências em saúde pública no município do Rio de Janeiro.

MoreTranslated text

Key words

centro de operações de emergência,covid-19,capacidade de resposta ante emergências

求助PDF

上传PDF

View via Publisher

AI Read Science

AI Summary

AI Summary is the key point extracted automatically understanding the full text of the paper, including the background, methods, results, conclusions, icons and other key content, so that you can get the outline of the paper at a glance.

Example

Background

Key content

Introduction

Methods

Results

Related work

Fund

Key content

- Pretraining has recently greatly promoted the development of natural language processing (NLP)

- We show that M6 outperforms the baselines in multimodal downstream tasks, and the large M6 with 10 parameters can reach a better performance

- We propose a method called M6 that is able to process information of multiple modalities and perform both single-modal and cross-modal understanding and generation

- The model is scaled to large model with 10 billion parameters with sophisticated deployment, and the 10 -parameter M6-large is the largest pretrained model in Chinese

- Experimental results show that our proposed M6 outperforms the baseline in a number of downstream tasks concerning both single modality and multiple modalities We will continue the pretraining of extremely large models by increasing data to explore the limit of its performance

Upload PDF to Generate Summary

Must-Reading Tree

Example

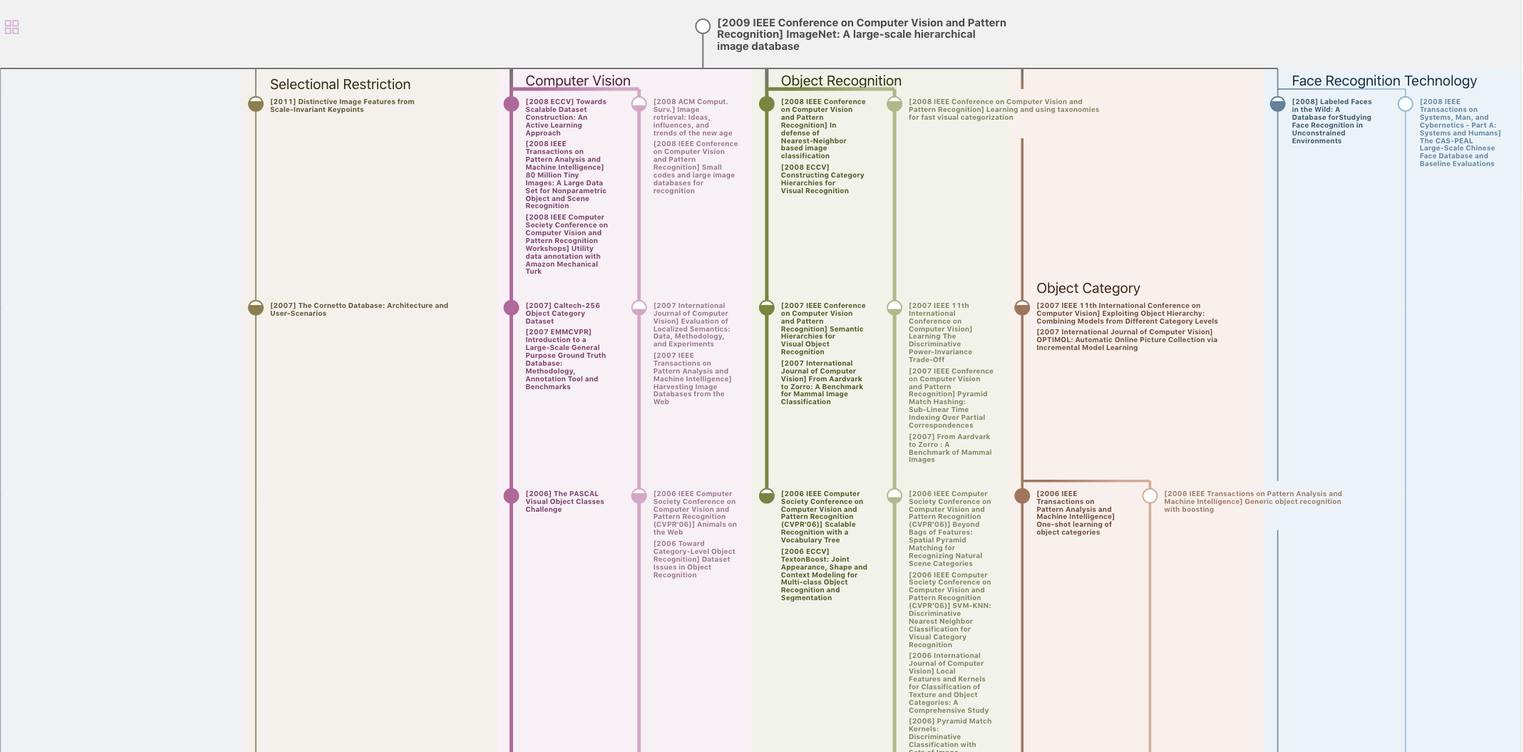

Generate MRT to find the research sequence of this paper

Related Papers

Data Disclaimer

The page data are from open Internet sources, cooperative publishers and automatic analysis results through AI technology. We do not make any commitments and guarantees for the validity, accuracy, correctness, reliability, completeness and timeliness of the page data. If you have any questions, please contact us by email: report@aminer.cn

Chat Paper