Investigação Da Atividade Antimicrobiana De Extratos E Frações De Espécies De Piper Usando Bioautografia

Research Society and Development(2021)

Abstract

A necessidade do desenvolvimento de novos fármacos utilizados no combate e/ou controle dos micro-organismos permanece significativa no contexto científico mundial, sendo os produtos naturais, dentre eles os produtos vegetais, potenciais fontes de novos agentes antibacterianos e antifúngicos. Desse modo, o objetivo deste trabalho foi determinar a atividade antimicrobiana de espécies de Piper por bioautografia. Atividade antimicrobiana foi realizada pelo método da bioautografia, onde foram preparadas, previamente, cromatogramas pela técnica de cromatografia em camada delgada (CCD) pela eluição do extrato etanólico bruto (EEB), fração hexânica (HEX) e/ou fração clorofórmica (CHCl3) de P. caldense, P. arboreum e P. mollicomum, a fim de separar os metabólitos. As placas de CCD foram testadas diante de quatro cepas padrão American Type Culture Collection: Staphylococcus aureus ATCC 25923, Escherichia coli ATCC 25922, Pseudomonas aeruginosa ATCC 27853 e Candida albicans ATCC 76645, sendo a atividade determinada pela formação de zonas de inibição em Agar. Foi possível verificar que tanto o EEB como a fração HEX de Piper caldense foram ativos frente à cepa de S. aureus, as zonas de inibição foram observadas na cromatoplaca. No entanto estes produtos não apresentaram atividade diante das demais cepas estudadas. Os extratos e frações de Piper arboreum e Piper mollicomum não apresentaram atividade frente as cepas testadas. A partir dos resultados é possível concluir que Piper caldense possui potencial atividade antibacteriana frente a S. aureus. Ressalta-se a importância para que estudos futuros sejam realizados para identificação das substâncias ativas bem como seu teor em cada parte da planta.

MoreTranslated text

求助PDF

上传PDF

View via Publisher

AI Read Science

AI Summary

AI Summary is the key point extracted automatically understanding the full text of the paper, including the background, methods, results, conclusions, icons and other key content, so that you can get the outline of the paper at a glance.

Example

Background

Key content

Introduction

Methods

Results

Related work

Fund

Key content

- Pretraining has recently greatly promoted the development of natural language processing (NLP)

- We show that M6 outperforms the baselines in multimodal downstream tasks, and the large M6 with 10 parameters can reach a better performance

- We propose a method called M6 that is able to process information of multiple modalities and perform both single-modal and cross-modal understanding and generation

- The model is scaled to large model with 10 billion parameters with sophisticated deployment, and the 10 -parameter M6-large is the largest pretrained model in Chinese

- Experimental results show that our proposed M6 outperforms the baseline in a number of downstream tasks concerning both single modality and multiple modalities We will continue the pretraining of extremely large models by increasing data to explore the limit of its performance

Upload PDF to Generate Summary

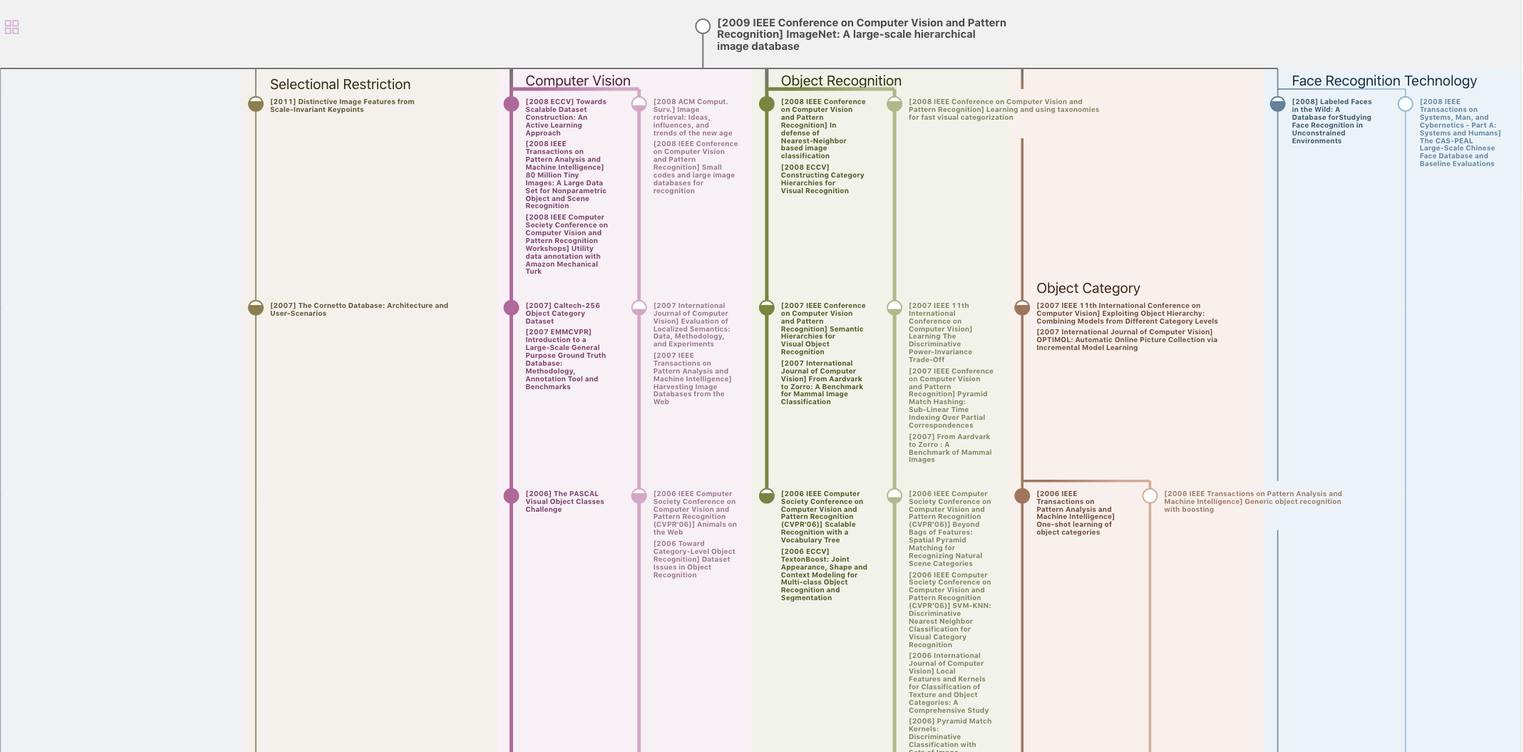

Must-Reading Tree

Example

Generate MRT to find the research sequence of this paper

Related Papers

2006

被引用13 | 浏览

2018

被引用25 | 浏览

2006

被引用26 | 浏览

2012

被引用8 | 浏览

Data Disclaimer

The page data are from open Internet sources, cooperative publishers and automatic analysis results through AI technology. We do not make any commitments and guarantees for the validity, accuracy, correctness, reliability, completeness and timeliness of the page data. If you have any questions, please contact us by email: report@aminer.cn

Chat Paper

GPU is busy, summary generation fails

Rerequest