CS-UM6P at SemEval-2021 Task 1 - A Deep Learning Model-based Pre-trained Transformer Encoder for Lexical Complexity.

SemEval@ACL/IJCNLP(2021)

关键词

lexical complexity,transformer encoder,model-based,pre-trained

AI 理解论文

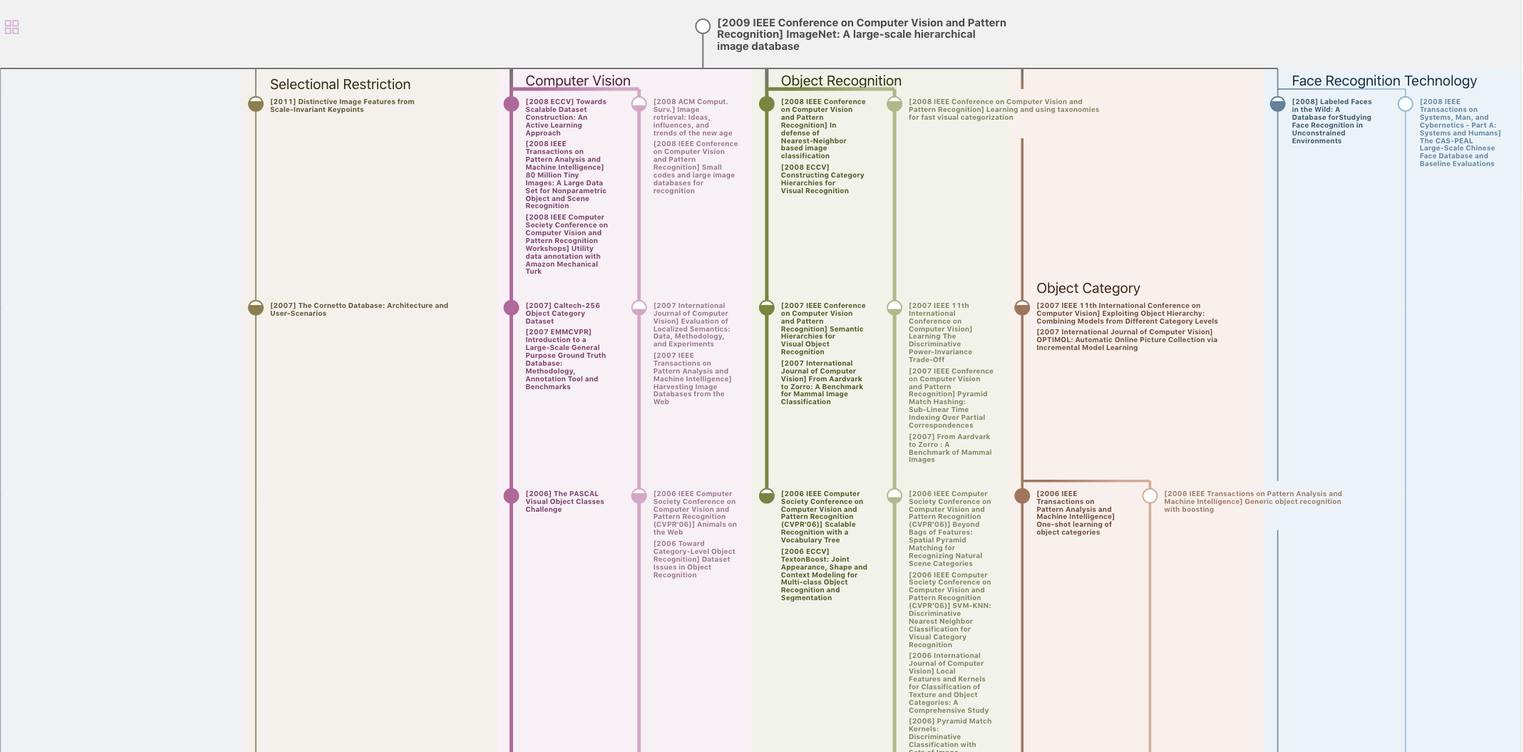

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要