Empirische Arbeit: Evaluation Des KlasseKinderSpiels Im Kontext Einer Tutoriellen Leseförderung

Psychologie in Erziehung und Unterricht(2020)SCI 4区

Abstract

In der aktuellen Untersuchung wird mit einer Stichprobe von 69 Kindern mit externalisierenden Verhaltensproblemen (dritte und vierte Jahrgangsstufe) die Wirkung des KlasseKinderSpiels im Kontext einer tutoriellen Lesefördermethode (reziprokes Lehren) evaluiert. In einem Zwei-Gruppen-Design wird überprüft, ob der zusätzliche Einsatz des KlasseKinderSpiels während der tutoriellen Maßnahme zu einer verbesserten Regeleinhaltung, einer allgemeinen Verhaltensförderung, einer erfolgreicheren Leseförderung und einer gesteigerten sozialen Integration der Kinder führt. Die Studienergebnisse sprechen insgesamt eher für die Förderung ohne KlasseKinderSpiel. Bei der Betrachtung der Subgruppen zeigt sich jedoch rein deskriptiv, dass Kinder mit starken Verhaltensproblemen während der Umsetzung des KlasseKinderSpiels eine bessere Regeleinhaltung zeigten. Die Befunde werden methodisch und pädagogisch diskutiert. Weiterhin werden Implikationen für den schulischen Einsatz und weitere Forschungsvorhaben abgeleitet.

MoreTranslated text

求助PDF

上传PDF

View via Publisher

AI Read Science

AI Summary

AI Summary is the key point extracted automatically understanding the full text of the paper, including the background, methods, results, conclusions, icons and other key content, so that you can get the outline of the paper at a glance.

Example

Background

Key content

Introduction

Methods

Results

Related work

Fund

Key content

- Pretraining has recently greatly promoted the development of natural language processing (NLP)

- We show that M6 outperforms the baselines in multimodal downstream tasks, and the large M6 with 10 parameters can reach a better performance

- We propose a method called M6 that is able to process information of multiple modalities and perform both single-modal and cross-modal understanding and generation

- The model is scaled to large model with 10 billion parameters with sophisticated deployment, and the 10 -parameter M6-large is the largest pretrained model in Chinese

- Experimental results show that our proposed M6 outperforms the baseline in a number of downstream tasks concerning both single modality and multiple modalities We will continue the pretraining of extremely large models by increasing data to explore the limit of its performance

Upload PDF to Generate Summary

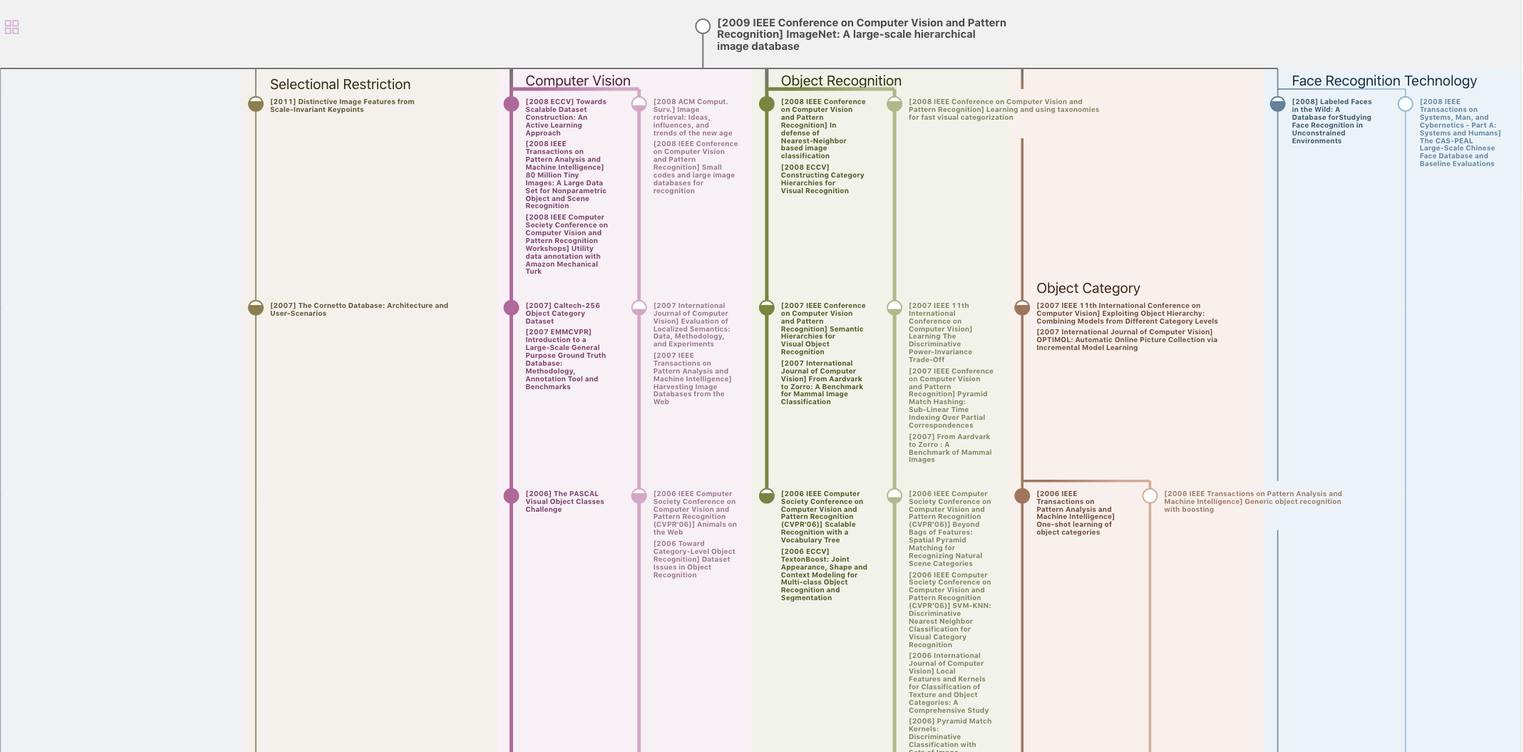

Must-Reading Tree

Example

Generate MRT to find the research sequence of this paper

Related Papers

Reading Game Sport from the Perspective of Sociology of Knowledge.

Journal of Environmental and Public Health 2022

被引用0

Data Disclaimer

The page data are from open Internet sources, cooperative publishers and automatic analysis results through AI technology. We do not make any commitments and guarantees for the validity, accuracy, correctness, reliability, completeness and timeliness of the page data. If you have any questions, please contact us by email: report@aminer.cn

Chat Paper

GPU is busy, summary generation fails

Rerequest