隐蔽图像后门攻击

wf(2023)

摘要

目的 图像后门攻击是一种经典的对抗性攻击形式,后门攻击使被攻击的深度模型在正常情况下表现良好,而当隐藏的后门被预设的触发器激活时就会出现恶性结果.现有的后门攻击开始转向为有毒样本分配干净标签或在有毒数据中隐蔽触发器以对抗人类检查,但这些方法在视觉监督下很难同时具备这两种安全特性,并且它们的触发器可以很容易地通过统计分析检测出来.因此,提出了一种隐蔽有效的图像后门攻击方法.方法 首先通过信息隐藏技术隐蔽图像后门触发,使标签正确的中毒图像样本(标签不可感知性)和相应的干净图像样本看起来几乎相同(图像不可感知性).其次,设计了一种全新的后门攻击范式,其中毒的源图像类别同时也是目标类.提出的后门攻击方法不仅视觉上是隐蔽的,同时能抵御经典的后门防御方法(统计不可感知性).结果 为了验证方法的有效性与隐蔽性,在ImageNet、MNIST、CIFAR-10数据集上与其他3种方法进行了对比实验.实验结果表明,在3个数据集上,原始干净样本分类准确率下降均不到1%,中毒样本分类准确率都超过94%,并具备最好的图像视觉效果.另外,验证了所提出的触发器临时注入的任意图像样本都可以发起有效的后门攻击.结论 所提出的后门攻击方法具备干净标签、触发不可感知、统计不可感知等安全特性,更难被人类察觉和统计方法检测.

更多AI 理解论文

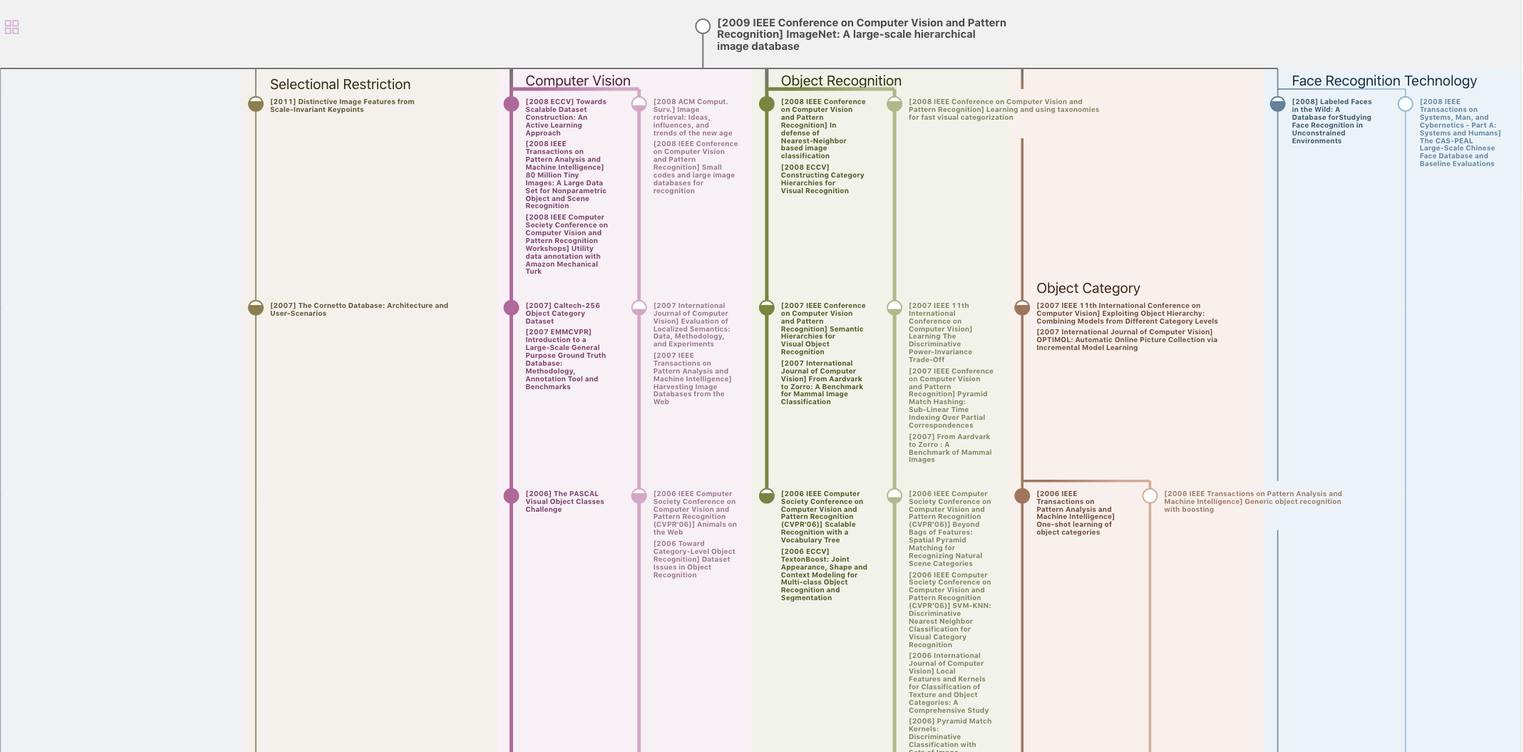

溯源树

样例

生成溯源树,研究论文发展脉络

Chat Paper

正在生成论文摘要